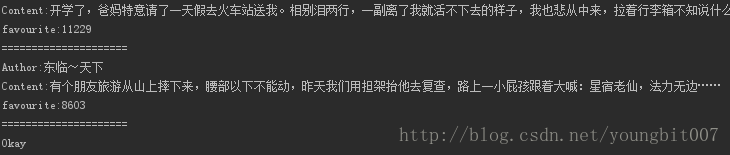

(.*?)', re.S) items = re.findall(pattern, content) for item in items: print("Author:"+item[0]) print("Content:"+ item[1]) print("favourite:"+ item[2]) print("=====================")except urllib.error.HTTPError as e: print(e.code)except urllib.error.URLError as e: print(e.reason)else: print("Executed!")

python3爬虫(二)实战- 爬糗事百科

本文共 3904 字,大约阅读时间需要 13 分钟。

2017-3-09 代码如下.

必须加上head否则无法抓取.# -*- coding:utf-8 -*-import urllib.requestimport urllib.errorimport reimport timepage = 1url = 'http://www.qiushibaike.com/hot/page/' + str(page)user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)'headers = { 'User-Agent' : user_agent }count=0try: request = urllib.request.Request(url, headers = headers) response = urllib.request.urlopen(request) content = response.read().decode('utf-8') print(content) time.sleep(2) pattern =re.compile('(.*?)

.*? .*? (.*?).*? 尽管核心部分已经完成了,但是还需要将代码更改为面向对象的形式。

import urllib.requestimport reclass qsbkClassCrawler: # 初始化方法,定义一些变量 def __init__(self): self.pageIndex = 1 self.user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)' # 初始化headers self.headers = { 'User-Agent': self.user_agent} # 存放段子的变量,每一个元素是每一页的段子们 self.stories = [] # 存放程序是否继续运行的变量 self.enable = False # 传入某一页的索引获得页面代码 def getPage(self, pageIndex): try: url = 'http://www.qiushibaike.com/hot/page/' + str(pageIndex) # 构建请求的request request = urllib.request.Request(url, headers=self.headers) # 利用urlopen获取页面代码 response = urllib.request.urlopen(request) # 将页面转化为UTF-8编码 pageCode = response.read().decode('utf-8') return pageCode except urllib.request.URLError as e: if hasattr(e, "reason"): print(u"连接糗事百科失败,错误原因", e.reason) return None # 传入某一页代码,返回本页不带图片的段子列表 def getPageItems(self, pageIndex): pageCode = self.getPage(pageIndex) if not pageCode: print("页面加载失败...") return None pattern = re.compile( '(.*?)

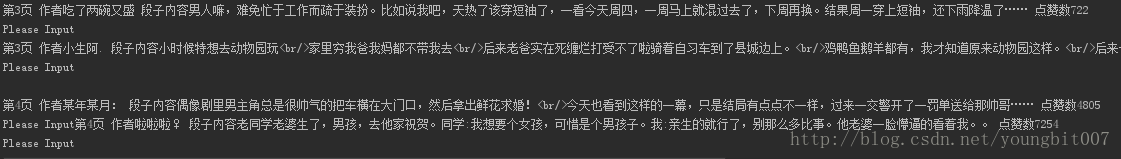

.*? .*? (.*?).*? (.*?)', re.S) items = re.findall(pattern, pageCode) pageStories=[] for item in items: pageStories.append([item[0].strip(),item[1].strip(), item[2].strip()]) return pageStories # 加载并提取页面的内容,加入到列表中 def loadPage(self): # 如果当前的页数少于两页,则加载新的一页 if self.enable == True: if len(self.stories) < 2: #获取新的一页 pageStories = self.getPageItems(self.pageIndex) # 将该页的段子存放到全局list中 if pageStories: self.stories.append(pageStories) # 获取完之后页码索引加一,表示下次读取下一页 self.pageIndex += 1 def getOneStory(self, pageStories, page): # 遍历一页的段子 for story in pageStories: income = input('Please Input') # 每当输入回车一次,判断一下是否要加载新页面 self.loadPage() if income == 'Q': self.enable = False return print("第%d页 作者%s 段子内容%s 点赞数%s" % (page,story[0],story[1],story[2])) def start(self): print("正在读取糗事百科,按回车查看新段子,Q退出") #使变量为true,程序可以正常运行 self.enable=True #先加载一页内容 self.loadPage() #局部变量,控制当前读了几页 nowPage =0 while self.enable: if len(self.stories) > 0: #从全局list中获取一页的段子 pageStories= self.stories[0] #当前读到的页数加一 nowPage +=1 #将全局list中第一个元素删除,因为已经取出 del self.stories[0] #输出该页的段子 self.getOneStory(pageStories,nowPage)if __name__ == "__main__": spider = qsbkClassCrawler() spider.start() 这是python爬虫的第一个实战,继续努力,小伙伴们共勉

你可能感兴趣的文章

丰田生产方式(TPS)的本质

查看>>

Django之提交表单与前后端交互

查看>>

mongos-sharding连接池配置

查看>>

html2canvas的踩坑之路

查看>>

wumii 爆款总结经验

查看>>

芯咖汇沙龙首战告捷,与诸位AI大咖一起探讨人工智能

查看>>

BLUEGUARD-E智能锁,门锁和手机自动组成cp

查看>>

在家也能逛家居商场!宜家推出VR购物应用

查看>>

java学习笔记--常用类(System,Runtime,date类, Math 数学类,Random 随机数类 )

查看>>

面对前车之鉴的AR,现在的VR要做些什么?

查看>>

Fitbit表高兴太早,廉价手环和智能手表的威胁就在眼前

查看>>

为什么SAP默默开始区块链研究测试

查看>>

Redis Sentinel安装、配置和部署

查看>>

英伟达联合达索系统与水晶石,打造VR行业应用推广中心

查看>>

PostgreSQL增强版命令行客户端(pgcli)

查看>>

关于SDN的未来,Linux基金会专访阿里云网络大神

查看>>

凯文·凯利:虚拟现实将取代微信!

查看>>

北航联合哈佛,研制出吸盘式仿生机器人

查看>>

廖方宇:数据与计算是科技创新倍增器

查看>>

redis 集群搭建

查看>>